De koppen spreken van “Afkeer”, de data zegt “Afwachtend”

Pew Research bracht onlangs twee grote onderzoeken over AI uit: één die het Amerikaanse sentiment onder de loep nam en de andere die het wereldwijde landschap in kaart bracht. De koppen zijn niet mals. In de VS zegt 53% van de volwassenen dat AI de menselijke creativiteit zal verslechteren. De helft zegt dat het ons vermogen om betekenisvolle relaties te vormen zal aantasten, terwijl slechts 5% denkt dat het deze zal verbeteren.

Van de 25 landen die wereldwijd werden onderzocht, is er geen enkel land waar een meerderheid van de volwassenen “eerder enthousiast dan bezorgd” is. De meest bezorgde bevolkingsgroepen bevinden zich in de VS, Italië, Australië en Brazilië. Dus koppen sommige media schreeuwerig dat “Amerikanen AI haten“

Maar dit is een oppervlakkige interpretatie. Het verwart ruis met het signaal. Dit is geen afwijzing van AI. Het is een teken dat adoptie lijdt onder een heftige groeistuip. En dat konden we natuurlijk ook verwachten.

Het lawaai van de hype vs. het geluid van gebruikers

Achter de data ontvouwt zich een specifieke, genuanceerde frustratie die de “haat”-koppen missen. Het is niet zo dat mensen de technologie haten, maar wel de manier waarop het ons wordt opgedrongen.

Het is de paradox van “oppervlakkige bekendheid”. Een studie geciteerd in de rapportage vond dat de grootste fans van AI vaak de meest oppervlakkige bekendheid met de (achterliggende) technologie hebben. De power-users met veel kennis van AI zijn vaak het meest voorzichtig. Het grote publiek, overspoeld met hype en slechte implementaties, reageert op de marketing, niet op de technologie. Ze zien AI in elke app gepropt worden, ook als dat geen enkel nuttig voordeel oplevert. Ze zien de wildgroei aan modellen die hallucineren en AI-slop genereren. Ze zien de miljarden aan investeringen die uiteindelijk een keer moeten worden terugverdient. Mensen vertrouwen Microsoft. Ze tolereren Google. Ze bewonderden Musk ooit om de Tesla. Maar de agressieve, top-down opdringing van AI roept echte weerstand op.

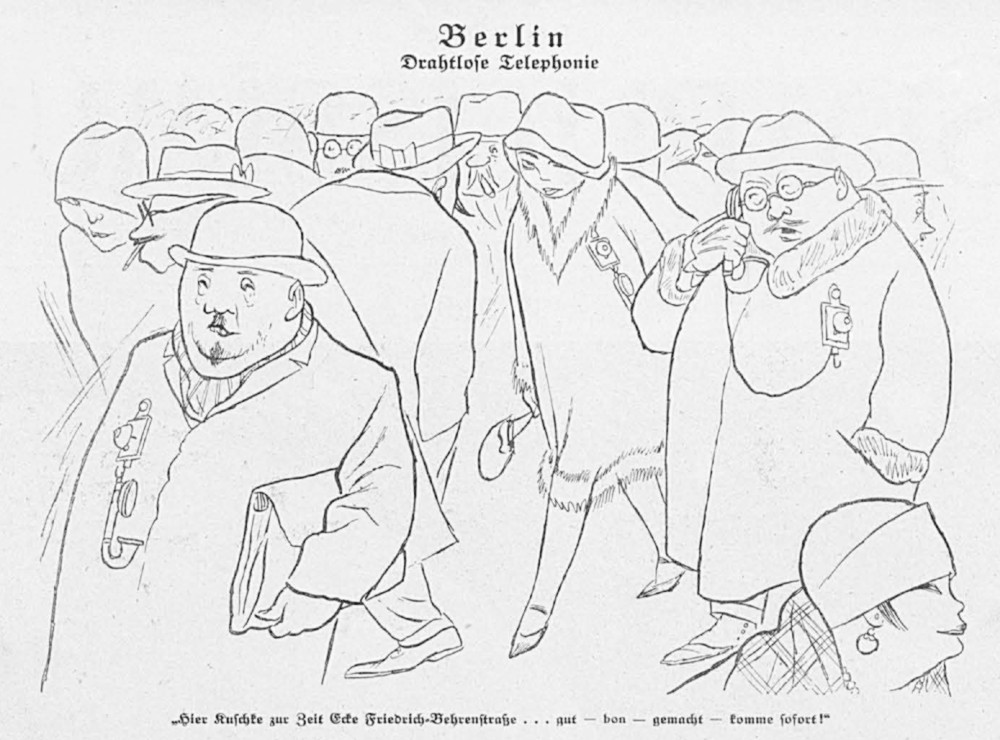

De oer-reflex: Wanneer de geschiedenis zich herhaalt

En er is de oerangst voor verandering. De trein, elektriciteit, de ponskaart, de mobiele telefoon, het internet. Wanneer mensen zich de positieve kant niet onmiddellijk kunnen voorstellen, vergroten we de negatieve kant uit. We geven AI de schuld van het lui maken van studenten in plaats van vol in te zetten op het onderwijs van morgen. We zijn bang voor de voorbeelden van AI die leidden tot zelfdoding, in plaats van in te zetten op betere hulpmiddelen voor de geestelijke gezondheidszorg. We smalen om hallucinaties terwijl we over het hoofd zien hoe die beruchte oom van alles bij elkaar verzint tijdens het kerstdiner. We beweren dat het kunst vernietigt, net zoals we ooit dachten dat de camera en synthesizer schilders en muzikanten bedreigen. We maken ons zorgen dat het onze banen steelt, maar negeren dat het ook veel nieuwe creëert. (De angst is nu valide, ongeacht de uitkomst op de lange termijn.) De duizelingwekkende snelheid van de uitrol van AI dwingt ons om de vaardigheidskloof te dichten, en dat is waar het echte werk begint.

The Demand for Labels, Not Bans

The Pew data also highlights a critical demand for transparency. 76% of respondents say it is “extremely or very important” to be able to tell if content is made by AI, yet 53% lack the confidence to do so. This a demand for a label, not rejection. Just as we require ingredient lists on food or nutrition facts on packaging, the public wants to know what they are consuming. The 80% who believe presenting AI content as human-made should be illegal are not asking for a ban; they are asking for honesty.

The Trust Deficit: A Crisis of Governance, Not Code

These reflexes are human. They are a necessary check to ensure we manage AI wisely over the long term. The skepticism is less about the tool and more about the industry. The absence of coherent policy and regulation is a crisis of trust, not a rejection of the technology itself.

The fact that most people cannot distinguish a human voice from a synthetic one proves how advanced the tech has become. (Amazing!) That carries risk, yes. And it demands rules. Just like traffic laws. Or a monopoly on violence. Not everyone gets to fire a gun.

The US is losing its moral authority on AI, and the world is noticing. When the originator of the technology cannot be trusted to govern it, the global community looks elsewhere. This is not a victory for authoritarianism; it is a failure of democratic oversight. The gap between what we promise and what we deliver has become a canyon.

Slowing Down to Speed Up

We need to slow down. Not to stop, but to steer. The rush to integrate AI everywhere has left us with a tool that is powerful but directionless. We are trying to drive a Formula 1 car on a dirt road with no brakes, and then acting surprised when people are scared to get in the passenger seat. The solution is not to smash the car. It is to build the track.

The Path Forward

We must prioritize human agency over algorithmic speed. Slowing down allows us to ask the hard questions: Who benefits? Who loses? Where are the safeguards?

If you are a leader, stop forcing adoption metrics and start building trust frameworks. If you are a worker, stop fearing replacement and start mastering the craft of human-AI collaboration. The future does not belong to the machines. It belongs to the humans who know how to steer them.

Let’s hit the brakes, look at the road, and decide where we are actually going.